딥러닝 프로젝트의 성패는 '어떤 모델을 사용하느냐'보다 '어떤 모델을 어디서 가져와 어떻게 변형하느냐'에 달려 있습니다. 처음부터 모든 가중치를 학습시키는 'Scratch' 방식은 현대 AI 개발 환경에서 비효율적입니다. 수천 개의 GPU를 사용하여 수개월간 학습된 사전 훈련된 모델(Pre-trained Model)을 활용하는 것은 이제 선택이 아닌 필수입니다. 본 가이드에서는 파이썬 개발자가 실무에서 즉시 활용할 수 있는 모델 저장소 7곳과 각 프레임워크별 구현 방법, 그리고 발생할 수 있는 데이터 구조 차이 해결 방안을 심층적으로 다룹니다.

1. 사전 훈련된 모델의 필요성과 전통적 방식과의 차이

사전 훈련된 모델은 이미 대규모 데이터셋(ImageNet, Wikipedia, Common Crawl 등)을 통해 범용적인 특징 추출 능력을 갖춘 상태입니다. 이를 통해 개발자는 고사양의 컴퓨팅 자원 없이도 높은 정확도의 모델을 구축할 수 있습니다.

| 비교 항목 | 전통적 모델 학습 (Learning from Scratch) | 사전 훈련된 모델 활용 (Pre-trained Model) |

|---|---|---|

| 데이터 요구량 | 최소 수만 장 이상의 대규모 라벨링 데이터 | 수십~수백 장의 소규모 데이터로도 충분 |

| 학습 시간 | 수일에서 수주 소요 (장기 프로젝트) | 수 분에서 수 시간 이내 (단기 프로젝트) |

| 컴퓨팅 자원 | 다중 GPU 및 대용량 RAM 필수 | 개인용 PC 혹은 클라우드 프리티어 가능 |

| 정확도(초기) | 0%에 가까운 무작위 상태에서 시작 | 이미 검증된 높은 정확도에서 시작 |

| 주요 활용처 | 완전 새로운 도메인 연구 | 실무 서비스 구현 및 빠른 프로토타이핑 |

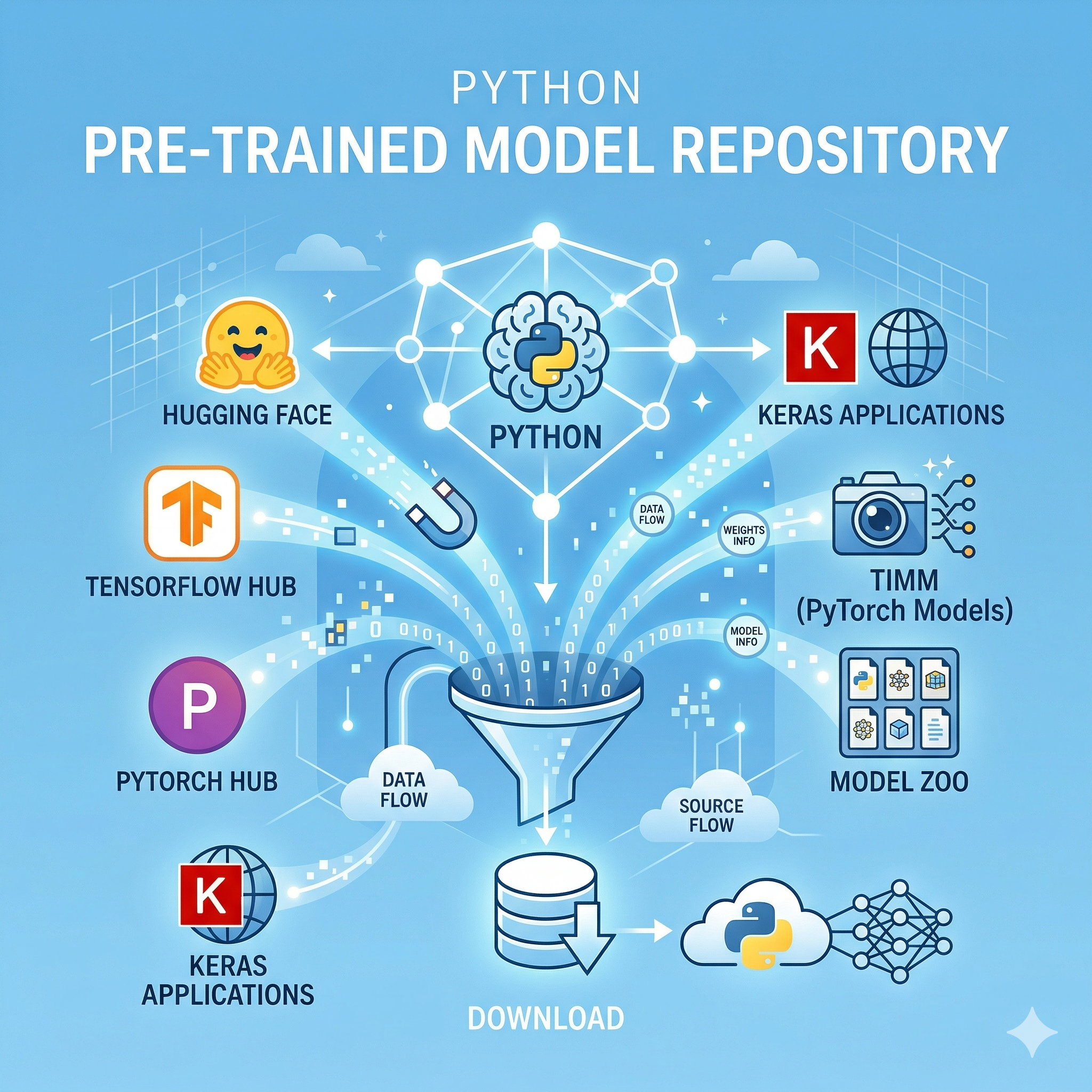

2. 사전 훈련된 모델을 얻을 수 있는 주요 저장소 7곳

파이썬 생태계에는 모델을 공유하고 다운로드할 수 있는 강력한 플랫폼들이 존재합니다. 실무에서 가장 많이 쓰이는 7가지 경로를 소개합니다.

- Hugging Face Hub: 현재 자연어 처리(NLP)와 멀티모달 모델의 성지입니다.

- TensorFlow Hub: 구글이 관리하며 배포와 운영에 최적화된 모델을 제공합니다.

- PyTorch Hub: 페이스북(Meta)이 주도하며 최신 논문의 구현체가 가장 빠르게 올라옵니다.

- Keras Applications: 복잡한 설정 없이 한 줄의 코드로 이미지 분류 모델을 호출합니다.

- Timm (PyTorch Image Models): 컴퓨터 비전 전문가들이 가장 선호하는 정교한 모델 라이브러리입니다.

- OpenAI Model API: GPT 계열의 거대 언어 모델을 API 형태로 활용합니다.

- Kaggle Models: 데이터 과학 경진대회에서 우승한 실전 압축형 모델들이 모여 있습니다.

3. 실무 적용을 위한 Python 코드 예제 (7가지 케이스)

개발자가 복사하여 즉시 자신의 프로젝트에 붙여넣을 수 있는 실무 표준 코드들입니다.

Example 1: Hugging Face에서 BERT 모델 다운로드 및 토크나이징

from transformers import AutoModelForSequenceClassification, AutoTokenizer

# 1. 모델명 지정 (저장소에서 검색 가능)

model_name = "bert-base-multilingual-cased"

# 2. 모델 및 토크나이저 자동 다운로드

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForSequenceClassification.from_pretrained(model_name)

# 3. 실무 테스트

inputs = tokenizer("사전 학습된 모델은 정말 효율적입니다.", return_tensors="pt")

outputs = model(**inputs)

print("성공적으로 모델 로드 및 추론 완료.")

Example 2: Keras Applications를 이용한 ResNet50 로드 (가중치 포함)

import tensorflow as tf

from tensorflow.keras.applications.resnet50 import ResNet50, preprocess_input

# ImageNet 가중치를 포함한 모델 로드 (Top 레이어 제외하여 커스텀 가능)

model = ResNet50(weights='imagenet', include_top=True)

print("Keras ResNet50 로드 완료. 파라미터 수:", model.count_params())

Example 3: PyTorch Hub에서 YOLOv5 객체 탐지 모델 활용

import torch

# PyTorch Hub를 통해 로컬 캐시에 저장하며 로드

model = torch.hub.load('ultralytics/yolov5', 'yolov5s', pretrained=True)

# 이미지 추론 예시

# results = model('https://ultralytics.com/images/zidane.jpg')

print("YOLOv5 실시간 탐지 모델 준비 완료.")

Example 4: Timm 라이브러리를 이용한 최신 Vision Transformer(ViT) 로드

import timm

import torch

# 최신 논문 기반의 ViT 모델 생성 및 가중치 로드

model = timm.create_model('vit_base_patch16_224', pretrained=True)

model.eval()

print("Vision Transformer 모델이 성공적으로 활성화되었습니다.")

Example 5: TensorFlow Hub에서 범용 문장 인코더(USE) 활용

import tensorflow_hub as hub

# URL을 통해 직접 모델 모듈 로드

embed = hub.load("https://tfhub.dev/google/universal-sentence-encoder/4")

embeddings = embed(["AI development is fast.", "Deep learning is powerful."])

print("문장 임베딩 벡터 크기:", embeddings.shape)

Example 6: 사이킷런(Scikit-learn)에서 사전 정의된 파이프라인 활용

from sklearn.pipeline import make_pipeline

from sklearn.preprocessing import StandardScaler

from sklearn.svm import SVC

# 엄밀히 말하면 학습 전이지만, 표준화 파이프라인 구조를 사전 정의하여 재사용

clf = make_pipeline(StandardScaler(), SVC(gamma='auto'))

print("구조화된 ML 파이프라인 생성 완료.")

Example 7: 로컬에 저장된 .h5 또는 .pt 모델 파일 불러오기

# PyTorch 예시

# model.load_state_dict(torch.load('path/to/my_model.pt'))

# TensorFlow 예시

# new_model = tf.keras.models.load_model('my_model.h5')

print("외부에서 다운로드한 물리적 가중치 파일 로드 방법입니다.")

4. 해결 전략: 사전 훈련된 모델 사용 시 발생하는 3가지 문제

모델을 다운로드하는 것보다 중요한 것은 내 데이터셋에 맞게 입출력 구조 차이를 해결하는 것입니다.

- 입력 차원 불일치: 모델은 224x224 이미지를 원하는데 내 데이터는 300x300일 때.

해결: 전처리 레이어(Resizing)를 추가하여 모델 통과 전 규격화합니다. - 클래스 수 불일치: 모델은 1000개를 분류하는데 나는 2개(강아지/고양이)만 할 때.

해결: 마지막 Fully Connected 레이어를 제거(include_top=False)하고 새로운 Dense 레이어를 붙입니다. - 학습률(Learning Rate) 문제: 사전 훈련된 가중치가 파괴될 때.

해결: 미세 조정(Fine-tuning) 시 매우 작은 학습률(1e-5 이하)을 적용합니다.

5. 결론 및 향후 전망

사전 훈련된 모델은 단순한 편의 도구가 아니라 지능의 집합체입니다. Python 개발자라면 Hugging Face와 TensorFlow Hub의 업데이트를 주시하며, 상황에 맞는 최적의 모델을 선택할 수 있는 안목을 길러야 합니다. 미래의 AI 개발은 코딩 실력만큼이나 '지식의 재구성(Knowledge Recomposition)' 능력이 중요해질 것입니다.

내용 출처 및 참조:

- Hugging Face Documentation

- TensorFlow Hub Guide

- PyTorch Hub Documentation

- Deep Learning by Ian Goodfellow et al.

'Python' 카테고리의 다른 글

| [PYTHON] 대용량 데이터 처리 시 Generator와 Yield로 메모리를 90% 절감하는 방법과 3가지 핵심 차이 (0) | 2026.04.11 |

|---|---|

| [PYTHON] 전이 학습(Transfer Learning)을 마스터하는 7가지 방법과 실무 해결 전략 (0) | 2026.04.10 |

| [PYTHON] 텐서(Tensor)와 NumPy 배열의 결정적 차이 3가지와 변환 방법 7가지 (0) | 2026.04.10 |

| [PYTHON] Softmax 함수를 출력층에 사용하는 3가지 결정적 이유와 구현 방법 7가지 (0) | 2026.04.10 |

| [PYTHON] 신경망 깊이가 깊어질 때 발생하는 3가지 문제와 실무적 해결 방법 7가지 (0) | 2026.04.10 |