파이썬을 활용해 딥러닝 모델을 설계하다 보면 epochs, batch_size, iterations라는 용어를 끊임없이 마주하게 됩니다. 이 용어들은 단순히 숫자를 의미하는 것이 아니라, 모델이 데이터를 얼마나 세밀하게 훑고 가중치를 얼마나 자주 업데이트할지를 결정하는 학습의 리듬을 상징합니다. 특히 대규모 데이터셋을 다룰 때 이 개념의 차이를 모르면 모델의 수렴 속도가 느려지거나 메모리 부족(OOM) 현상을 해결하지 못하는 난관에 봉착하게 됩니다. 본 포스팅에서는 에포크와 이터레이션의 수학적 관계를 명확히 정의하고, 실무에서 마주하는 학습 조기 종료 방법과 데이터 로더 최적화를 포함한 7가지 이상의 고급 파이썬 예제를 제공합니다.

1. 에포크 vs 이터레이션: 개념의 경계와 관계

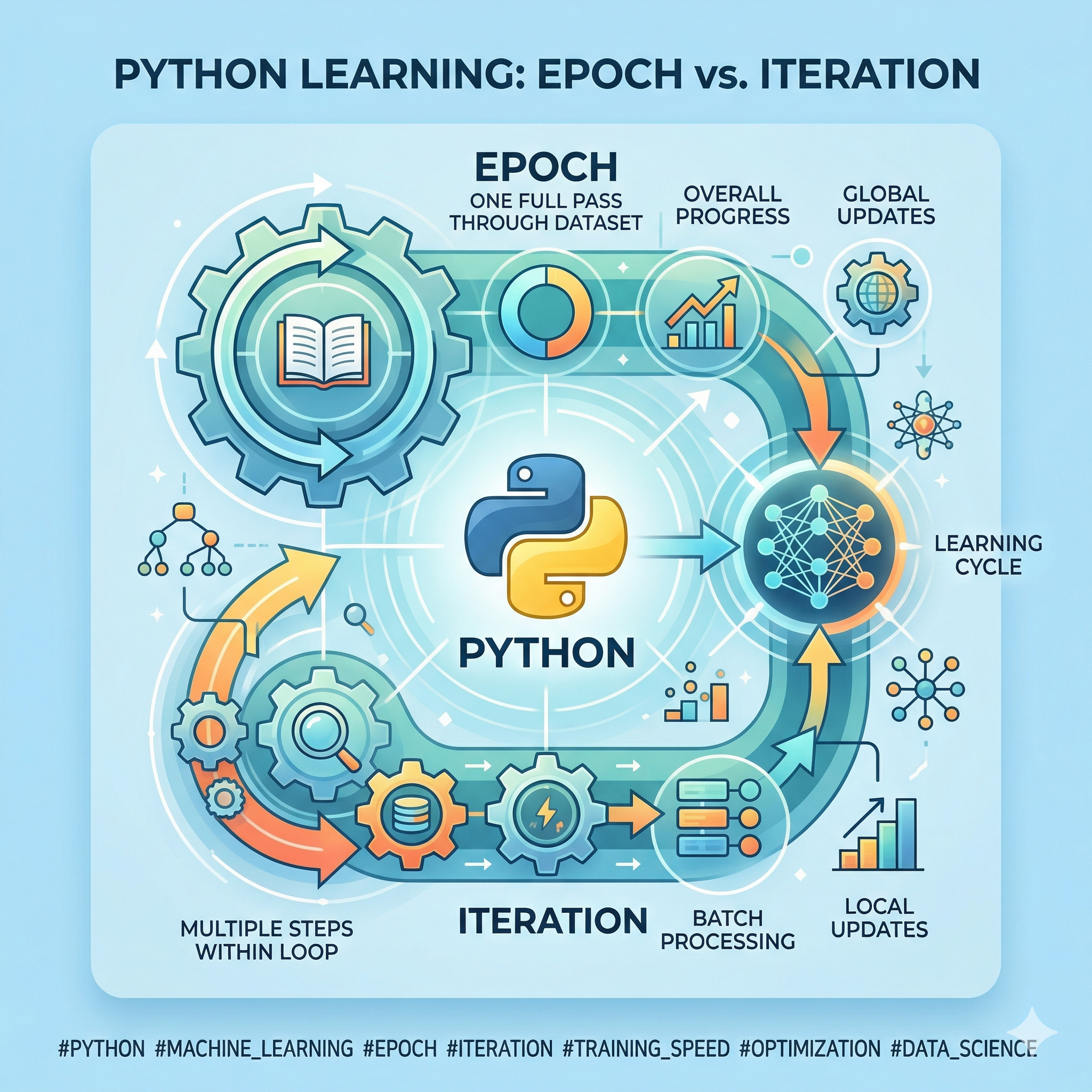

전체 데이터를 한 권의 책이라고 가정해 봅시다. 에포크는 책 전체를 처음부터 끝까지 한 번 읽는 행위이며, 이터레이션은 책을 여러 페이지(배치)로 나누어 읽을 때 한 번 페이지를 넘기며 요약(가중치 업데이트)하는 행위를 의미합니다.

에포크, 이터레이션, 배치 사이즈의 핵심 비교

| 항목 | 에포크 (Epoch) | 이터레이션 (Iteration) | 배치 사이즈 (Batch Size) |

|---|---|---|---|

| 의미 | 전체 데이터셋이 신경망을 통과한 횟수 | 한 에포크 내에서 가중치가 업데이트된 횟수 | 한 번의 업데이트에 사용되는 데이터 묶음 크기 |

| 수학적 공식 | (총 데이터 수 / 배치 사이즈) * 이터레이션 | 총 데이터 수 / 배치 사이즈 | 총 데이터 수 / 이터레이션 |

| 목표 | 전체적인 학습 성숙도 결정 | 세부적인 최적화 및 수렴 유도 | 메모리 효율 및 기울기 안정성 확보 |

| 실무적 관점 | "모델을 얼마나 오래 공부시킬까?" | "한 에포크에 몇 번이나 개선할까?" | "한 번에 몇 문제를 풀고 답을 맞출까?" |

2. 왜 이 개념을 구분하는 것이 중요한가?

만약 데이터가 1,000개이고 배치 사이즈가 10이라면, 1 에포크를 완료하기 위해 100번의 이터레이션이 필요합니다. 이때 이터레이션마다 가중치가 업데이트되므로, 에포크가 같더라도 배치 사이즈가 작아지면 이터레이션이 늘어나 학습 시간이 길어지는 대신 모델이 더 세밀하게 조정되는 해결 방법이 도출됩니다.

3. [Practical Examples] 실무 최적화를 위한 Python 예제 7선

실제 딥러닝 파이프라인에서 에포크와 이터레이션을 제어하고 성능을 극대화하는 파이썬 코드들입니다.

Example 1: NumPy를 이용한 에포크 및 이터레이션 수동 계산법

import math

total_data = 10500

batch_size = 64

# 한 에포크당 필요한 이터레이션 계산 (올림 처리)

iterations_per_epoch = math.ceil(total_data / batch_size)

print(f"1 에포크당 이터레이션 횟수: {iterations_per_epoch}")

total_epochs = 50

total_iterations = iterations_per_epoch * total_epochs

print(f"전체 학습 과정에서의 총 업데이트 횟수: {total_iterations}")

Example 2: PyTorch DataLoader에서의 이터레이션 루프 구현

from torch.utils.data import DataLoader, TensorDataset

import torch

# 데이터셋 생성

x = torch.randn(100, 5)

y = torch.randn(100, 1)

loader = DataLoader(TensorDataset(x, y), batch_size=20, shuffle=True)

for epoch in range(2): # 2 Epochs

print(f"--- Epoch {epoch+1} Start ---")

for i, (inputs, targets) in enumerate(loader): # Iterations

print(f"Iteration {i+1}: 가중치 업데이트 중...")

Example 3: 과적합 방지를 위한 Early Stopping(조기 종료) 방법

# 에포크가 너무 많아질 때 성능 저하를 막는 해결책

best_loss = float('inf')

patience = 5

counter = 0

for epoch in range(1000):

val_loss = train_one_epoch() # 가상 함수

if val_loss < best_loss:

best_loss = val_loss

counter = 0

else:

counter += 1

if counter >= patience:

print(f"학습 조기 종료: {epoch} 에포크에서 중단")

break

Example 4: 이터레이션 기반의 학습률 스케줄링 (Learning Rate Decay)

from torch.optim.lr_scheduler import StepLR

optimizer = torch.optim.SGD(model.parameters(), lr=0.1)

# 10 이터레이션마다 학습률을 0.1배로 감소

scheduler = StepLR(optimizer, step_size=10, gamma=0.1)

Example 5: TensorFlow/Keras에서의 steps_per_epoch 활용 차이

# 데이터 제너레이터를 사용할 때 명시적으로 이터레이션(steps)을 지정

model.fit(train_gen,

steps_per_epoch=100, # 한 에포크당 100회 이터레이션 고정

epochs=10)

Example 6: 대용량 데이터를 위한 반복적 슬라이싱 처리 방법

def mini_batch_generator(data, labels, batch_size):

for i in range(0, len(data), batch_size):

yield data[i:i + batch_size], labels[i:i + batch_size]

# 메모리에 전체를 올리지 않고 이터레이션 수행

gen = mini_batch_generator(large_data, large_labels, 128)

Example 7: 프로그레스 바(tqdm)를 이용한 실시간 모니터링

from tqdm import tqdm

import time

# 이터레이션 진행 상황을 시각화하여 학습 정체 해결

for epoch in range(3):

pbar = tqdm(range(100), desc=f"Epoch {epoch}")

for i in pbar:

time.sleep(0.01) # 가상 연산

pbar.set_postfix({'loss': 0.5 / (i + 1)})

4. 학습 최적화를 위한 전략적 체크리스트

- 데이터가 너무 적다면? 에포크를 늘리되, 이터레이션 노이즈를 줄이기 위해 배치 사이즈를 작게 조정하십시오.

- 학습 속도가 너무 느리다면? 이터레이션 횟수를 줄이기 위해 배치 사이즈를 키우고, 그에 비례하여 학습률(Learning Rate)을 높여 보십시오.

- 검증 오차가 널뛰기한다면? 이터레이션 과정에서의 가중치 업데이트가 너무 공격적일 수 있습니다. 에포크를 늘리고 학습률을 낮추는 것이 해결 방법입니다.

5. 결론: 에포크와 이터레이션의 조화

에포크와 이터레이션은 모델 학습의 거시적 관점과 미시적 관점을 대변합니다. 단순히 에포크 숫자를 높이는 것보다, 적절한 배치 사이즈 설정을 통해 이터레이션당 가중치 업데이트의 질을 높이는 것이 2026년 현대 인공지능 엔지니어링의 핵심 역량입니다. 본 가이드에서 제시한 7가지 해결 방법을 통해 여러분의 파이썬 모델이 최적의 수렴점에 도달하기를 바랍니다.

[내용 출처]

1. Scikit-learn Documentation: Neural Network models (Supervised)

2. Deep Learning with Python (François Chollet)

3. PyTorch Official Tutorials: Learning PyTorch with Examples

'Python' 카테고리의 다른 글

| [PYTHON] 역전파 (Backpropagation)의 3가지 핵심 원리와 체인 룰 해결 방법 (0) | 2026.04.09 |

|---|---|

| [PYTHON] 배치 사이즈(Batch Size) 선택이 모델 성능에 미치는 3가지 영향과 최적화 해결 방법 (0) | 2026.04.09 |

| [PYTHON] CNN 이미지 처리 최적화 방법과 3가지 핵심 알고리즘 차이 분석 (0) | 2026.04.09 |

| [PYTHON] CNN 성능 극대화의 핵심 : 풀링 레이어(Pooling Layer) 사용 이유와 3가지 해결 방법 (0) | 2026.04.09 |

| [PYTHON] 시계열 데이터의 혁명 : RNN과 LSTM의 3가지 결정적 차이와 실무 활용 방법 (0) | 2026.04.09 |