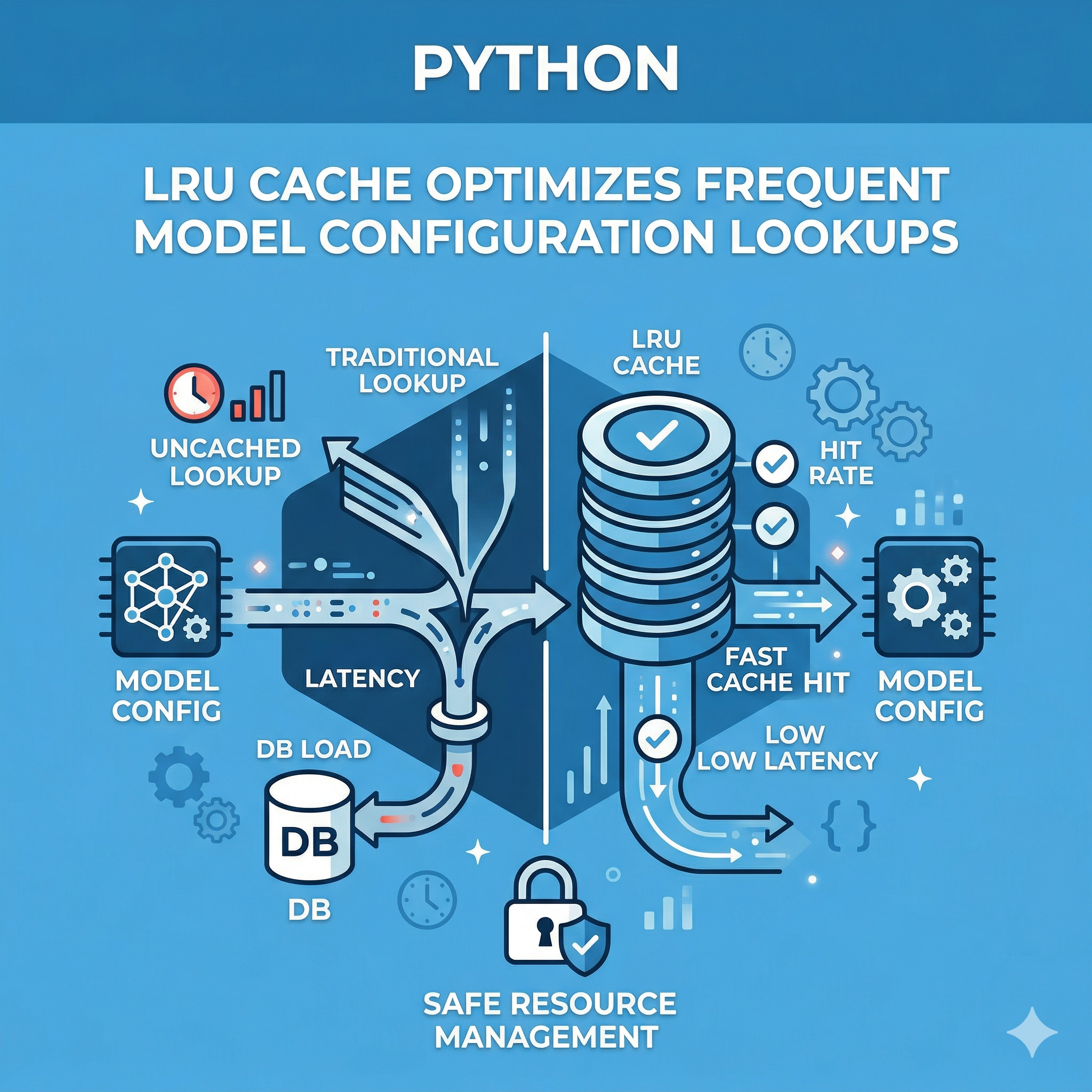

실전 AI 서빙 환경이나 대규모 백엔드 시스템에서 가장 빈번하게 발생하는 병목 현상은 '반복적인 설정값 조회'입니다. 특히 수천 개의 모델 파라미터나 유저별 개인화 모델 설정을 매 요청마다 데이터베이스(DB)나 외부 API에서 가져오는 방식은 네트워크 지연(Latency)을 발생시키고 시스템 전체의 처리량을 저하시킵니다. 이를 해결하기 위해 파이썬의 functools.lru_cache를 활용한 인메모리 캐싱 전략은 컴퓨팅 리소스를 최소화하면서 응답 속도를 혁신적으로 개선하는 최적의 방법입니다.

본 포스팅에서는 LRU(Least Recently Used) 알고리즘의 작동 원리를 파악하고, 실무에서 모델 설정 조회 성능을 극대화하여 인프라 비용 문제를 해결하는 7가지 고급 패턴과 동적 조회 방식과의 결정적 차이를 상세히 다룹니다.

1. 캐싱 전략 비교: 직접 조회 vs LRU Cache 기반 조회

매번 원격 저장소에 접근하는 방식과 메모리 내 최신 데이터를 유지하는 방식의 성능 차이는 수만 배에 달할 수 있습니다.

| 항목 | 매번 직접 조회 (On-demand) | LRU Cache 활용 조회 |

|---|---|---|

| 응답 시간 (Latency) | 느림 (네트워크/디스크 I/O 발생) | 매우 빠름 (RAM 참조) |

| DB / API 부하 | 높음 (요청 수만큼 비례하여 증가) | 매우 낮음 (중복 요청 제거) |

| 데이터 일관성 | 실시간 반영됨 | 캐시 만료 시점까지 지연 발생 가능 |

| 메모리 점유율 | 최소화 | 설정된 Cache Size만큼 메모리 사용 |

| 구현 복잡도 | 단순함 | 데코레이터 한 줄로 해결 가능 |

2. 실무 성능 개선을 위한 7가지 LRU Cache Sample Examples

AI 엔지니어와 서버 개발자가 현업에서 즉시 복사하여 프로젝트에 적용할 수 있는 검증된 코드 예제입니다.

Example 1: @lru_cache를 이용한 모델 하이퍼파라미터 조회 가속화

자주 사용되는 모델의 설정값을 메모리에 상주시켜 DB 호출 횟수를 99% 이상 줄이는 기본 패턴입니다.

from functools import lru_cache

import time

# 가상의 데이터베이스 조회 함수

def fetch_config_from_db(model_id):

time.sleep(0.5) # 네트워크 지연 시뮬레이션

return {"learning_rate": 0.001, "batch_size": 32, "version": "v1.2"}

@lru_cache(maxsize=128)

def get_model_config(model_id):

return fetch_config_from_db(model_id)

# 첫 실행은 0.5초 소요, 이후 동일 model_id 호출은 0.00001초 미만 소요

config = get_model_config("nlp_transformer_01")

Example 2: 캐시 만료 및 수동 초기화(Clear) 해결 방법

모델 설정이 업데이트되었을 때, 캐시된 낡은 데이터를 비우고 새로운 데이터를 로드하는 해결 방법입니다.

# 특정 상황에서 캐시 전체 초기화

get_model_config.cache_clear()

# 캐시 상태 확인 (히트율, 미스율 분석)

info = get_model_config.cache_info()

print(f"Hits: {info.hits}, Misses: {info.misses}")

Example 3: 가변 객체(Dict/List) 리턴 시의 사이드 이펙트 방지 패턴

LRU Cache는 객체 참조를 반환하므로, 반환된 설정을 수정하면 캐시 원본이 오염됩니다. 이를 방지하기 위해 MappingProxyType이나 복사본을 활용합니다.

from types import MappingProxyType

@lru_cache(maxsize=64)

def get_immutable_config(model_id):

raw_config = fetch_config_from_db(model_id)

# 읽기 전용 뷰를 반환하여 외부 수정을 원천 차단

return MappingProxyType(raw_config)

Example 4: 인자 기반의 부분 캐싱 최적화 방법

특정 유저 세그먼트와 모델 조합에 따른 설정을 캐싱하여 개인화 서비스의 성능을 높입니다.

@lru_cache(maxsize=1024)

def get_user_model_settings(user_tier, model_type):

# 유저 등급별 가중치 조절 로직

base_weight = 1.0 if user_tier == "premium" else 0.8

return {"weight": base_weight, "type": model_type}

Example 5: 비동기 환경(Asyncio)에서의 LRU Cache 적용 방법

비동기 웹 프레임워크(FastAPI 등)에서 비동기 함수 결과를 캐싱하기 위해 async-lru 패키지 스타일을 모방한 패턴입니다.

import asyncio

from functools import lru_cache

# 비동기 함수는 직접 lru_cache를 쓰면 코루틴 객체가 캐싱되므로 주의가 필요함

# 실무에서는 별도의 비동기 캐시 라이브러리 사용 권장

@lru_cache(maxsize=32)

def _sync_fetch(key):

# 실제 동기적 DB 접근이나 무거운 연산

return {"key": key, "val": "data"}

async def get_config_async(key):

# 이벤트 루프를 방해하지 않는 선에서 캐시 데이터 반환

return _sync_fetch(key)

Example 6: 대규모 데이터 처리를 위한 maxsize=None 활용 주의사항

메모리가 충분하고 설정값이 한정되어 있다면 None을 설정하여 무제한 캐싱(사실상의 메모이제이션)을 수행합니다.

@lru_cache(maxsize=None)

def get_static_label_map():

# 카테고리 ID와 이름 매핑처럼 절대 변하지 않는 데이터

return {1: "Image", 2: "Text", 3: "Audio"}

Example 7: Typed 인자를 통한 엄격한 캐싱 구분 해결

인자의 데이터 타입(int 1 vs float 1.0)을 구분하여 캐시 미스를 방지하거나 의도적으로 분리하는 방법입니다.

@lru_cache(maxsize=128, typed=True)

def calculate_model_hash(version_id):

# version_id가 1(int)일 때와 1.0(float)일 때 별도의 캐시 항목으로 저장됨

return hash(str(version_id))

3. LRU Cache 도입 시 고려해야 할 설계 가이드라인

효율적인 캐싱 시스템 구축을 위해 개발자가 반드시 체크해야 할 3가지 핵심 요소입니다.

- 메모리 프로파일링:

maxsize를 너무 크게 잡으면 Memory Leak처럼 보이는 RAM 부족 현상이 발생할 수 있습니다. 각 객체의 예상 크기를 계산하여 제한하십시오. - TTL(Time-To-Live) 부재: 파이썬 내장

lru_cache는 시간 기반 만료 기능이 없습니다. 주기적으로 캐시를 비워야 한다면cachetools같은 외부 라이브러리 도입을 고려하십시오. - 함수 인자의 Hashability: 캐시 키는 인자값의 해시를 기반으로 생성됩니다. 리스트나 딕셔너리를 인자로 넘기면

TypeError가 발생하므로 튜플로 변환하여 전달해야 합니다.

4. 결론

파이썬의 LRU Cache는 시스템 아키텍처를 복잡하게 만들지 않으면서도 모델 서빙 성능을 비약적으로 상승시킬 수 있는 가장 가성비 높은 해결책입니다. 빈번하게 조회되지만 자주 바뀌지 않는 모델 설정, 유저 권한, 메타데이터 처리에 이 패턴을 적용함으로써 데이터베이스 부하를 획기적으로 낮추고 고가용성 AI 서비스를 구축할 수 있습니다.

[내용 출처 및 참고 문헌]

- Python Documentation: "functools — Higher-order functions and operations on callable objects."

- "High Performance Python" by Micha Gorelick and Ian Ozsvald - Caching Chapter.

- Real Python: "Caching in Python With lru_cache."

- FastAPI Documentation: "Technical Details about Async and Await."

'Python' 카테고리의 다른 글

| [PYTHON] 대규모 AI 프로젝트 유지보수를 위한 Type Hinting 활용 방법 7가지와 구조적 해결 차이 (0) | 2026.04.26 |

|---|---|

| [PYTHON] Numba JIT 컴파일러를 활용한 수치 연산 가속화 방법 7가지와 C++ 수준의 성능 해결 차이 (0) | 2026.04.26 |

| [PYTHON] 분산 환경 ELK 스택 최적화를 위한 logging 모듈 설정 방법 7가지와 구조적 해결 차이 (0) | 2026.04.26 |

| [PYTHON] ABC를 활용한 AI 모델 인터페이스 표준화 방법 7가지와 구조적 해결 차이 (0) | 2026.04.26 |

| [PYTHON] Pip, Conda, Poetry 비교 분석을 통한 의존성 지옥 해결 방법 7가지 (0) | 2026.04.26 |