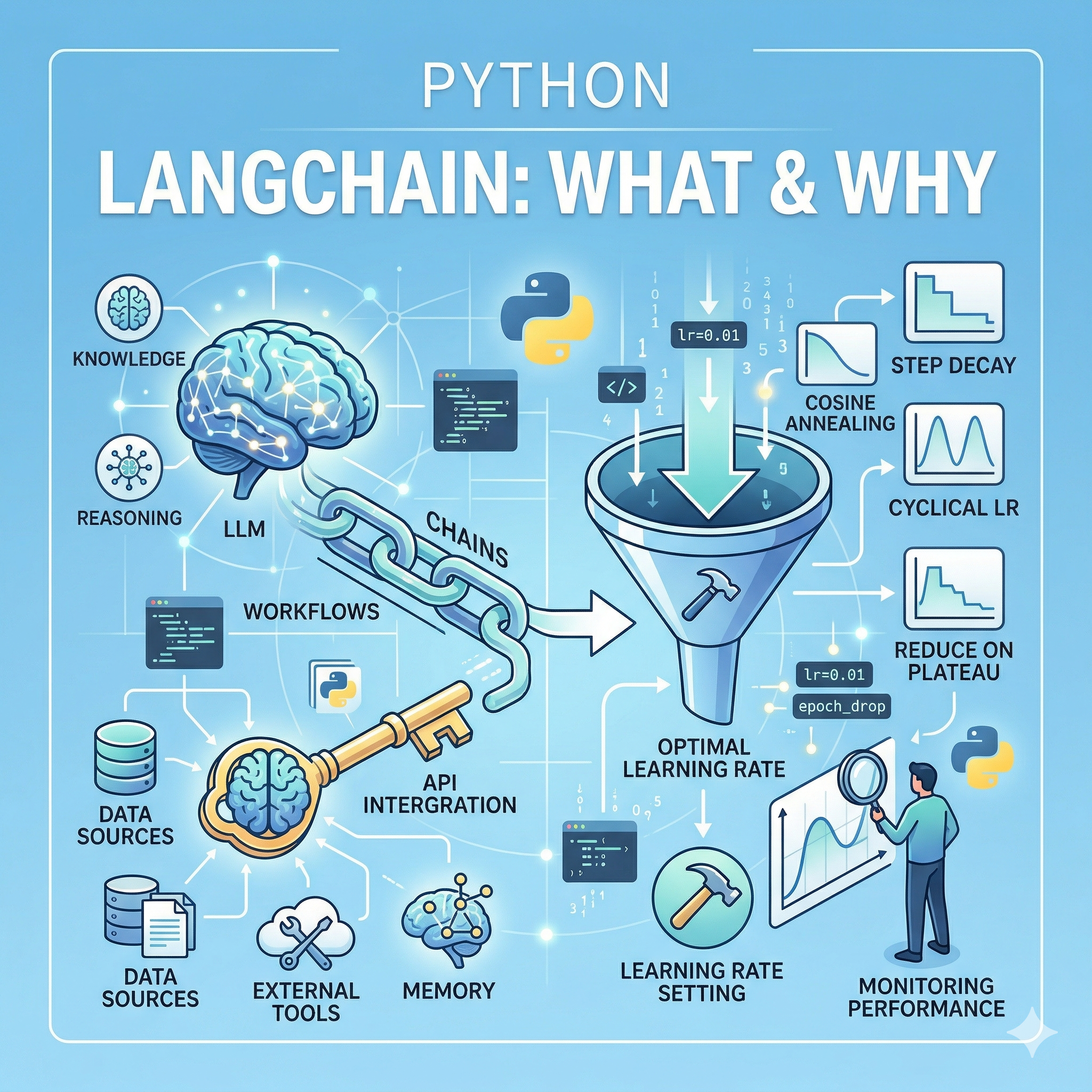

2026년 현재, 단순히 ChatGPT API를 호출하는 수준을 넘어 기업용 AI 애플리케이션을 구축하려는 개발자들에게 LangChain(랭체인)은 선택이 아닌 필수 프레임워크가 되었습니다. LLM(거대언어모델)은 그 자체로도 강력하지만, 최신 데이터에 접근하지 못하거나 복잡한 논리적 단계를 수행하는 데 한계가 있습니다. LangChain은 이러한 LLM의 한계를 보완하여 외부 데이터(PDF, SQL, Web)와 연결하고, 일련의 작업 흐름(Chain)을 설계하며, 스스로 도구를 사용하는 에이전트(Agent)를 구축할 수 있게 돕습니다. 본 가이드에서는 LangChain의 핵심 가치와 실무 해결 전략 7가지를 심층적으로 다룹니다.

1. LangChain의 핵심 개념과 직접 API 호출과의 결정적 차이

단순한 API 호출과 프레임워크 기반 개발은 '벽돌 한 장'과 '설계도 기반의 건축'만큼이나 큰 차이가 있습니다. LangChain은 모델 교체의 유연성과 복잡한 워크플로우 관리 능력을 제공합니다.

| 비교 항목 | 직접 API 호출 (Direct SDK) | LangChain 프레임워크 활용 |

|---|---|---|

| 모델 유연성 | 특정 모델(OpenAI 등)에 종속됨 | 코드 수정 최소화로 Anthropic, Llama 등 교체 가능 |

| 데이터 연결 | 수동으로 텍스트를 파싱하고 주입해야 함 | Document Loader를 통해 수백 가지 소스 즉시 연결 |

| 맥락 유지 (Memory) | 대화 이력을 수동으로 관리하고 잘라내야 함 | Window, Summary 등 다양한 메모리 기법 자동 지원 |

| 복합 작업 (Chains) | IF문과 루프로 복잡한 로직을 직접 구현 | LCEL(LangChain Expression Language)로 직관적 연결 |

| 확장성 (Agents) | 단일 응답에 국한됨 | LLM이 스스로 도구(Google, Python)를 선택해 실행 |

2. 실무자를 위한 LangChain 활용 노하우 7가지 (Python Code)

개발자가 현업에서 즉시 복사하여 프로젝트에 투입할 수 있는 2026년 표준 해결 예제입니다.

Example 1: LCEL을 이용한 기본 체인 구성 (Prompt + Model + Parser)

가장 기초적이면서 강력한 파이프라인 구성 방법입니다. 입력값이 프롬프트를 거쳐 모델로 전달되고, 결과를 문자열로 파싱합니다.

from langchain_openai import ChatOpenAI

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.output_parsers import StrOutputParser

# 1. 모델 및 프롬프트 설정

model = ChatOpenAI(model="gpt-4o")

prompt = ChatPromptTemplate.from_template("{topic}에 대해 짧게 설명해줘.")

parser = StrOutputParser()

# 2. 체인 연결 (LCEL: LangChain Expression Language)

chain = prompt | model | parser

# 3. 실행

print(chain.invoke({"topic": "LangChain의 가치"}))

Example 2: RAG(검색 증강 생성)를 위한 PDF 데이터 로딩 및 분할

내부 문서를 LLM에 학습시키지 않고 실시간으로 참고하게 만드는 해결 전략의 첫 단계입니다.

from langchain_community.document_loaders import PyPDFLoader

from langchain_text_splitters import RecursiveCharacterTextSplitter

# 1. PDF 로드

loader = PyPDFLoader("manual.pdf")

docs = loader.load()

# 2. 텍스트 분할 (토큰 제한 해결을 위한 청킹)

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=100)

splits = text_splitter.split_documents(docs)

print(f"분할된 문서 조각 개수: {len(splits)}")

Example 3: Vector Store(벡터DB) 저장 및 검색 해결 방법

분할된 문서를 벡터로 변환하여 질문과 가장 관련 있는 조각을 찾아내는 핵심 로직입니다.

from langchain_chroma import Chroma

from langchain_openai import OpenAIEmbeddings

# 1. 임베딩 및 벡터 저장소 구축

vectorstore = Chroma.from_documents(

documents=splits,

embedding=OpenAIEmbeddings(),

persist_directory="./chroma_db"

)

# 2. 검색기(Retriever) 설정

retriever = vectorstore.as_retriever(search_kwargs={"k": 3})

print("문서 벡터화 및 검색기 설정 완료")

Example 4: 대화 맥락 유지를 위한 Window Buffer Memory 적용

사용자와의 이전 대화를 기억하여 '그거 다시 설명해줘' 같은 대명사 질문에 대응하는 방법입니다.

from langchain.memory import ConversationBufferWindowMemory

from langchain.chains import ConversationChain

# 최근 5개의 대화만 기억하여 토큰 비용 최적화

memory = ConversationBufferWindowMemory(k=5)

conversation = ConversationChain(llm=model, memory=memory)

# 실행 시 맥락이 자동 포함됨

response = conversation.predict(input="안녕, 나는 개발자야.")

Example 5: 에이전트(Agent)를 통한 외부 도구(Search) 활용

LLM이 모르는 최신 정보를 얻기 위해 스스로 구글 검색을 수행하도록 만드는 해결책입니다.

from langchain import hub

from langchain.agents import AgentExecutor, create_openai_functions_agent

from langchain_community.tools.tavily_search import TavilySearchResults

# 1. 도구 및 프롬프트 정의

tools = [TavilySearchResults(max_results=1)]

prompt = hub.pull("hwchase17/openai-functions-agent")

# 2. 에이전트 생성 및 실행

agent = create_openai_functions_agent(model, tools, prompt)

agent_executor = AgentExecutor(agent=agent, tools=tools, verbose=True)

# agent_executor.invoke({"input": "오늘 서울 날씨 알려줘"})

Example 6: 다국어 번역 및 요약 멀티 체인 구성

하나의 입력을 받아 번역한 뒤, 그 결과를 다시 요약하는 복합 체인 해결 전략입니다.

translation_prompt = ChatPromptTemplate.from_template("다음 문장을 영어로 번역해: {text}")

summary_prompt = ChatPromptTemplate.from_template("다음 영문을 한 줄로 요약해: {english_text}")

# 체인 결합

full_chain = (

{"english_text": translation_prompt | model | parser}

| summary_prompt

| model

| parser

)

Example 7: LangSmith를 이용한 추적 및 디버깅

복잡한 체인 내부에서 어느 단계가 느린지, 어디서 에러가 나는지 시각적으로 확인하는 실무 노하우입니다.

import os

# 환경변수 설정만으로 모든 호출이 LangSmith에 기록됨

os.environ["LANGCHAIN_TRACING_V2"] = "true"

os.environ["LANGCHAIN_API_KEY"] = "your_api_key"

print("LangSmith 트레이싱 활성화: 성능 모니터링 준비 완료")

3. LangChain 도입 시 반드시 해결해야 할 3가지 이슈

- 추상화의 오버헤드: LangChain은 내부에서 많은 작업이 '마법처럼' 일어납니다. 디버깅이 어렵다면 LangSmith를 활용하여 내부 호출 로그를 반드시 확인하세요.

- 버전 업데이트 대응: 라이브러리가 매우 빠르게 변합니다.

langchain-core와 같은 핵심 패키지를 분리하여 종속성 문제를 관리해야 합니다. - 토큰 비용 관리: 에이전트나 긴 맥락의 메모리는 토큰을 과도하게 소모할 수 있습니다.

TokenUsage를 모니터링하고 적절한 청킹 전략을 세우세요.

4. 결론 및 향후 전망

LangChain은 단순한 라이브러리를 넘어 AI 에이전틱 워크플로우(Agentic Workflow)의 표준 플랫폼으로 자리 잡았습니다. 단순히 질문에 답하는 챗봇의 시대는 가고, 비즈니스 로직을 이해하고 스스로 문제를 해결하는 AI 시스템의 시대가 왔습니다. 파이썬 개발자로서 LangChain의 Chain, Vector Store, Agent 개념을 숙달하는 것은 2026년 AI 시장에서 가장 강력한 경쟁력을 갖추는 지름길입니다.

참고 문헌 및 출처 (Sources):

- LangChain Official Documentation (python.langchain.com)

- "LangChain 개발로 언어 모델 기반 애플리케이션 구축하기"

- "AI 자동화 트렌드: 멀티 에이전트와 에이전틱 구조"

- LangSmith 가이드: LLM 애플리케이션 추적 및 평가 (hellollama.net)

'Artificial Intelligence > 60. Python' 카테고리의 다른 글

| [PYTHON] 텍스트 데이터 전처리 5단계 순서와 자연어 처리 해결 방법 (0) | 2026.04.12 |

|---|---|

| [PYTHON] LLM(거대언어모델) 로컬 실행 방법 7가지와 클라우드와의 차이 및 하드웨어 해결 전략 (0) | 2026.04.12 |

| [PYTHON] RAG(검색 증강 생성) 핵심 개념과 7가지 구현 방법 및 환각 문제 해결 (0) | 2026.04.12 |

| [PYTHON] 파인튜닝(Fine-tuning)과 프롬프트 엔지니어링의 결정적 차이 3가지와 해결 방법 7가지 (0) | 2026.04.12 |

| [PYTHON] Hugging Face 라이브러리 필수 활용 방법 7가지와 전통적 모델링의 차이 해결 (0) | 2026.04.12 |