지금까지의 LLM 애플리케이션 개발은 '프롬프트 해킹'의 연속이었습니다. 모델이 바뀌거나 데이터가 변할 때마다 수동으로 프롬프트를 수정하는 일은 개발자들에게 큰 고통이었습니다. 본 포스팅에서는 이러한 방법론적 한계를 해결하기 위해 등장한 DSPy(Declarative Self-improving Language Programs, Pythonic) 프레임워크를 심층 분석합니다. 프롬프트를 수동으로 작성하는 대신 '프로그래밍'하고 '최적화'하는 DSPy만의 독창적인 효용성과 실무 적용 전략을 공개합니다.

1. DSPy란 무엇인가? 프롬프트에서 프로그램으로의 패러다임 전환

DSPy는 스탠포드 대학교 연구진이 개발한 프레임워크로, LLM 파이프라인을 '프롬프트 문자열'이 아닌 '모듈형 프로그램'으로 다룹니다. 핵심 아이디어는 간단합니다. 개발자는 프로그램의 논리적 구조(Signature)를 정의하고, DSPy의 옵티마이저(Teleprompter)가 데이터에 기반하여 해당 구조에 가장 적합한 프롬프트나 가중치를 자동으로 생성 및 최적화하도록 만드는 것입니다.

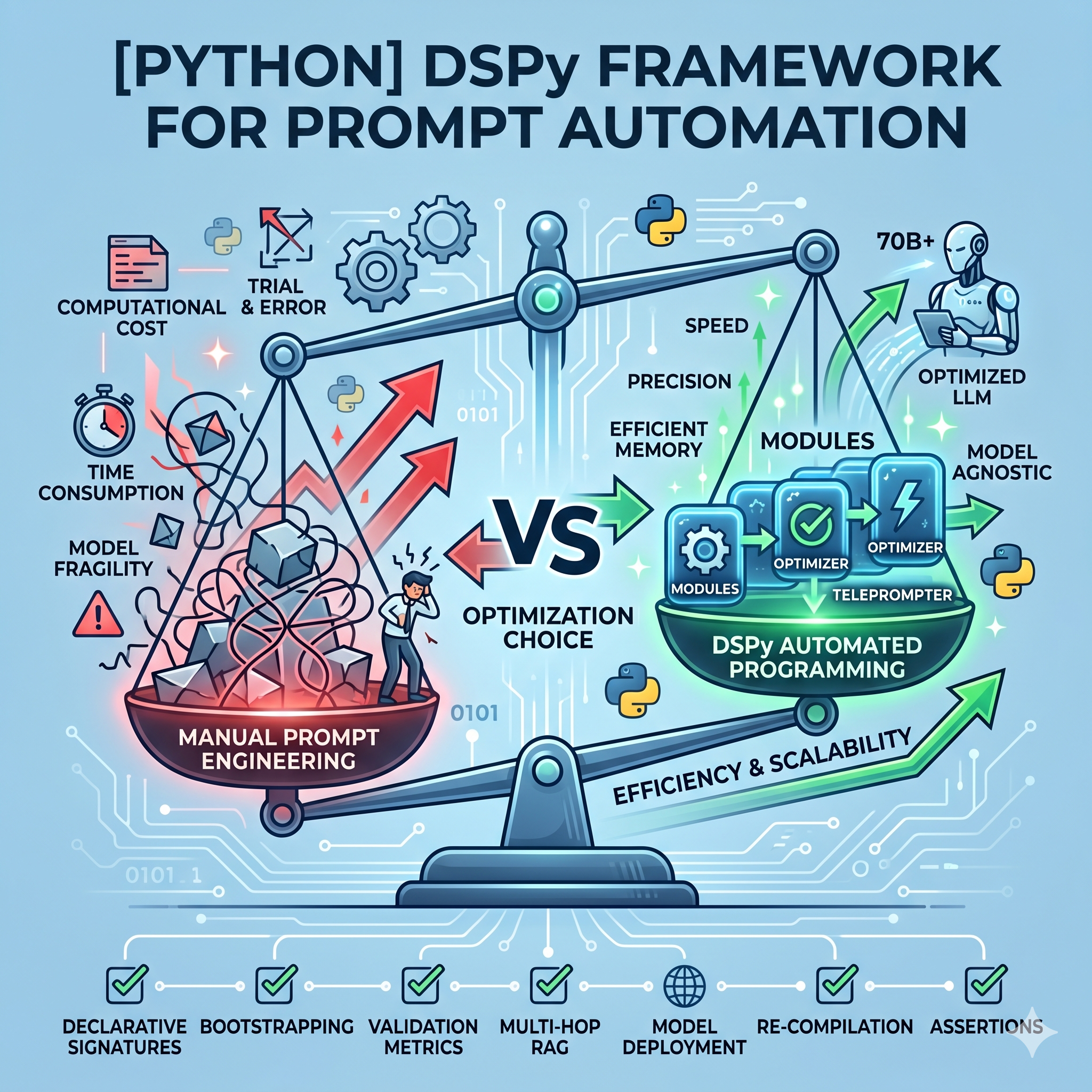

2. 기존 수동 프롬프트 엔지니어링 vs DSPy 자동화의 결정적 차이

두 방식의 기술적 접근과 유지보수 측면에서의 차이를 대조표를 통해 명확히 정의합니다.

| 비교 항목 | 전통적 프롬프트 엔지니어링 (LangChain 등) | DSPy 기반 프로그래밍적 접근 |

|---|---|---|

| 핵심 단위 | Prompt Template (문자열 중심) | Module & Signature (논리 구조 중심) |

| 최적화 방식 | 사람이 직접 문구를 수정 (Trial and Error) | Optimizer에 의한 자동 컴파일 (Compiler) |

| 모델 변경 대응 | 모델마다 프롬프트를 새로 작성해야 함 | 동일 코드로 타겟 모델에 맞는 최적 프롬프트 자동 생성 |

| 데이터 활용 | Few-shot 예시를 수동으로 선택 및 삽입 | 학습 데이터셋에서 최적의 예시를 자동 추출(Bootstrap) |

| 신뢰성 해결 | 프롬프트의 작은 변화에 결과가 크게 요동침 | 검증(Metric) 수치에 기반한 체계적 성능 개선 |

3. 실무 워크플로우를 혁신하는 7가지 DSPy 자동화 구현 예제

파이썬 개발자가 실무 프로젝트에서 DSPy를 활용해 프롬프트 엔지니어링을 자동화할 수 있는 7가지 실전 방법을 소개합니다.

Example 1: 기본 Signature 정의를 통한 선언적 프로그래밍

문자열 프롬프트 대신 입력과 출력의 관계를 선언하는 방식입니다.

import dspy

# 1. 시그니처 정의: 입력(질문) -> 출력(답변)

class SimpleQA(dspy.Signature):

"""질문에 대해 간결하고 정확하게 답변하십시오."""

question = dspy.InputField()

answer = dspy.OutputField(desc="전문적인 톤의 답변")

# 2. 모듈 사용 (Predictor)

predict = dspy.Predict(SimpleQA)

result = predict(question="DSPy의 가장 큰 장점은 무엇인가요?")

print(result.answer)

Example 2: Chain-of-Thought(CoT) 모듈 자동 적용

프롬프트에 "Step by step"을 직접 쓰는 대신, 모듈을 교체하는 것만으로 추론 과정을 자동 생성합니다.

# dspy.Predict 대신 dspy.ChainOfThought를 사용하면

# 모델에게 사고 과정을 출력하도록 하는 프롬프트가 자동으로 구성됩니다.

cot_module = dspy.ChainOfThought(SimpleQA)

response = cot_module(question="양자 컴퓨터가 암호화에 미치는 영향은?")

print(response.rationale) # 모델의 추론 과정 확인 가능

Example 3: BootstrapFewShot 옵티마이저를 이용한 자동 최적화

수동으로 Few-shot을 넣는 노가다를 해결하는 핵심 기능입니다.

from dspy.teleprompt import BootstrapFewShot

# 학습 데이터셋 준비 (질문-답변 쌍)

trainset = [dspy.Example(question="...", answer="...").with_inputs('question'), ...]

# 옵티마이저 설정

optimizer = BootstrapFewShot(metric=my_accuracy_metric)

# 컴파일: 모델이 스스로 최적의 Few-shot 예시를 학습하고 프롬프트를 생성함

compiled_program = optimizer.compile(SimpleQA(), trainset=trainset)

Example 4: 다중 홉(Multi-hop) 검색 에이전트 설계

복잡한 질문 해결을 위해 여러 번 검색하고 추론하는 과정을 파이프라인으로 구축합니다.

class MultiHopRAG(dspy.Module):

def __init__(self, passages_per_hop=3):

super().__init__()

self.retrieve = dspy.Retrieve(k=passages_per_hop)

self.generate_query = [dspy.ChainOfThought("context, question -> search_query") for _ in range(2)]

self.generate_answer = dspy.ChainOfThought("context, question -> answer")

def forward(self, question):

context = []

for hop in range(2):

query = self.generate_query[hop](context=context, question=question).search_query

context += self.retrieve(query).passages

return self.generate_answer(context=context, question=question)

Example 5: 데이터 검증(Metric) 시스템 구축

프롬프트가 잘 작동하는지 '느낌'이 아닌 '점수'로 판단하는 자동화 장치입니다.

def validate_answer(example, pred, trace=None):

# 정답 포함 여부, 길이 제한 등 비즈니스 로직 기반 메트릭 정의

is_correct = example.answer.lower() in pred.answer.lower()

return is_correct

# 이 메트릭은 옵티마이저가 프롬프트를 개선하는 기준으로 사용됨

Example 6: 모델 교체 시 자동 재컴파일 (Model Agnostic)

# GPT-4에서 Llama-3로 모델을 바꿀 때,

# 코드 수정 없이 옵티마이저만 다시 돌리면 Llama-3에 최적화된 문구로 바뀝니다.

llama3 = dspy.Llama3(model='...')

dspy.settings.configure(lm=llama3)

new_compiled_prog = optimizer.compile(SimpleQA(), trainset=trainset)

Example 7: Assertion을 통한 출력 제약 조건 강제 해결

# 모델이 특정 형식을 어기면 자동으로 다시 시도하도록 하는 가드레일

dspy.Suggest(

len(pred.answer) < 100,

"답변이 너무 깁니다. 더 요약해서 답변해 주세요."

)

4. DSPy 도입 시 마주하는 기술적 난관과 극복 전략

- 데이터셋의 필요성: DSPy는 옵티마이징을 위해 최소 20~50개의 예시 데이터가 필요합니다. 데이터가 부족하다면 LLM을 이용해 합성 데이터(Synthetic Data)를 생성하여 시작하십시오.

- 컴파일 비용: 옵티마이저가 최적의 조합을 찾기 위해 LLM을 여러 번 호출하므로 초기 비용이 발생합니다. 하지만 한 번 컴파일된 프롬프트는 영구적으로 재사용 가능하므로 장기적으로는 이득입니다.

- 복잡한 디버깅: 내부적으로 프롬프트가 어떻게 변하는지 추적하기 위해

dspy.inspect_history(n=1)기능을 적극 활용하여 가시성을 확보하세요.

5. 결론: 프롬프트 엔지니어링의 미래

더 이상 "너는 최고의 전문가야" 같은 문구를 고민하는 데 시간을 낭비하지 마십시오. DSPy는 LLM 개발 과정을 '연금술'에서 '공학'으로 바꾸어 놓았습니다. 로직을 시그니처로 선언하고, 데이터를 통해 옵티마이저가 최적의 프롬프트를 찾아내게 만드는 방식은 복잡한 AI 시스템의 유지보수성을 극적으로 높여줄 것입니다. 오늘 소개한 7가지 방법을 통해 진정한 프롬프트 자동화를 실현해 보시기 바랍니다.